El 'caso La Salle' de Tenerife: cómo controlar las aplicaciones que difaman a las mujeres a golpe de clic

Dos expertos en inteligencia artificial proponen actualizar los modelos educativos y regular el uso de esta tecnología para que no se repitan casos como el del Colegio La Salle

Un menor ve imágenes de chicas desnudas en tu teléfono móvil. / El Día

Los que crearon las fotos de falsos desnudos de alumnas de centros de la Isla encontradas en los teléfonos móviles de al menos dos matriculados de secundaria del Colegio La Salle de Santa Cruz de Tenerife lo tuvieron muy fácil. Les bastó con obtener una foto de las caras de las menores e introducirlas en una de las decenas de aplicaciones libres y gratuitas que circulan por internet para la manipulación de imágenes con inteligencia artificial. En este caso usaron la app Undress. En unos segundos se pueden hacer fotos y vídeos que solo sirven para denigrar la imagen y el honor de esas chicas.

Dos expertos en inteligencia artificial lanzan dos propuestas esenciales para que hechos como este no se repitan: mejorar y actualizar los modelos educativos para que los menores tengan clara la gravedad de estas conductas y aprobar un marco regulatorio para que aplicaciones como la usada en el caso de La Salle no estén al alcance de cualquiera.

El reto tiene una enorme complejidad. Lo asegura el catedrático José Andrés Moreno, ingeniero informático de la Universidad de La Laguna (ULL). Usa una comparación extrema para enfatizar la importancia de la responsabilidad a la hora de usar cualquier herramienta. «Mire lo que pasa con las armas. Están ahí y pueden caer en manos de personas irresponsables. La clave está en el uso que se le da a herramientas que pueden ser muy peligrosas. Otro ejemplo: un menor no puede conducir un coche pero si lo hace, ¿de quién es la culpa?», reflexiona.

Los expertos advierten de las consecuencias del mal uso de la inteligencia artificial. / El Día

Moreno admite que las familias se enfrentan a un dilema muy complejo en la educación de sus hijos. «¿Cómo controlar que niñas y niños se vean influenciados por modelos erróneos que ven en todas partes? ¿Cómo controlar lo que hacen en internet cuando existen tantos atajos y tantas opciones para burlar cualquier restricción? Es muy complicado».

Juan Albino Méndez, ingeniero de control y automático de la ULL, reconoce que las aplicaciones para hacer los deekfakes (ultrafalsos), es decir, este tipo de manipulaciones con fotos y vídeos, campan a sus anchas en la red. «La inteligencia artificial no se ha creado para esto. Esto es algo que hay que tener muy en cuenta», quiere dejar claro Méndez. «La inteligencia artificial se creó para ayudar a la sociedad, para mejorar la productividad, aportar soluciones, mejorar la eficiencia de procesos como las investigaciones científicas. No surgió para crear herramientas con las que denigrar a las personas. Pero lo cierto es que existen, cada vez hay más y están abiertas a todo el mundo», explica.

¿Cómo controlar que niñas y niños se vean influenciados por modelos erróneos que ven en todas partes?

Este ingeniero focaliza la solución en «un marco regulatorio claro que sigue sin aprobarse». Considera que deben adoptarse medidas para restringir estas herramientas que dan la oportunidad de hacer un uso perverso de la inteligencia artificial. «Europa culmina un marco pero no termina de aprobarlo y de que entre en vigor. Luego habría que ver qué eficacia tiene», recuerda Albino.

Después de casi tres años de negociaciones, la Unión Europea (UE) aprobó el pasado 2 de febrero la primera ley sobre inteligencia artificial (IA) del mundo. Reunidos en Bruselas, los embajadores de los 27 estados miembros refrendaron el «histórico» acuerdo político alcanzado el pasado diciembre. Prohibirá los usos que supongan un «riesgo inaceptable». Es el caso de los sistemas de puntuación social y de la manipulación cognitiva de grupos vulnerables. También establecerá límites más o menos estrictos para otras aplicaciones de esta tecnología en función de sus peligros.

Después de casi tres años de negociaciones, la Unión Europea aprobó el pasado 2 de febrero la primera ley sobre inteligencia artificial (IA) del mundo pero no ha entrado en vigor

Albino aclara que este marco normativo aún no se ha aprobado de forma definitiva ni ha entrado por tanto en vigor. A la espera de esta ley, ¿se puede técnicamente restringir o prohibir el uso de aplicaciones como las que alteran las imágenes o el mismo acceso a los contenidos pornográficos? Los dos expertos creen que sí de forma genérica pero no para grupos de edades; es decir, se puede bloquear el acceso a webs y aplicaciones pero para todo el mundo, no para los de una edad en concreto, como por ejemplo menores de edad.

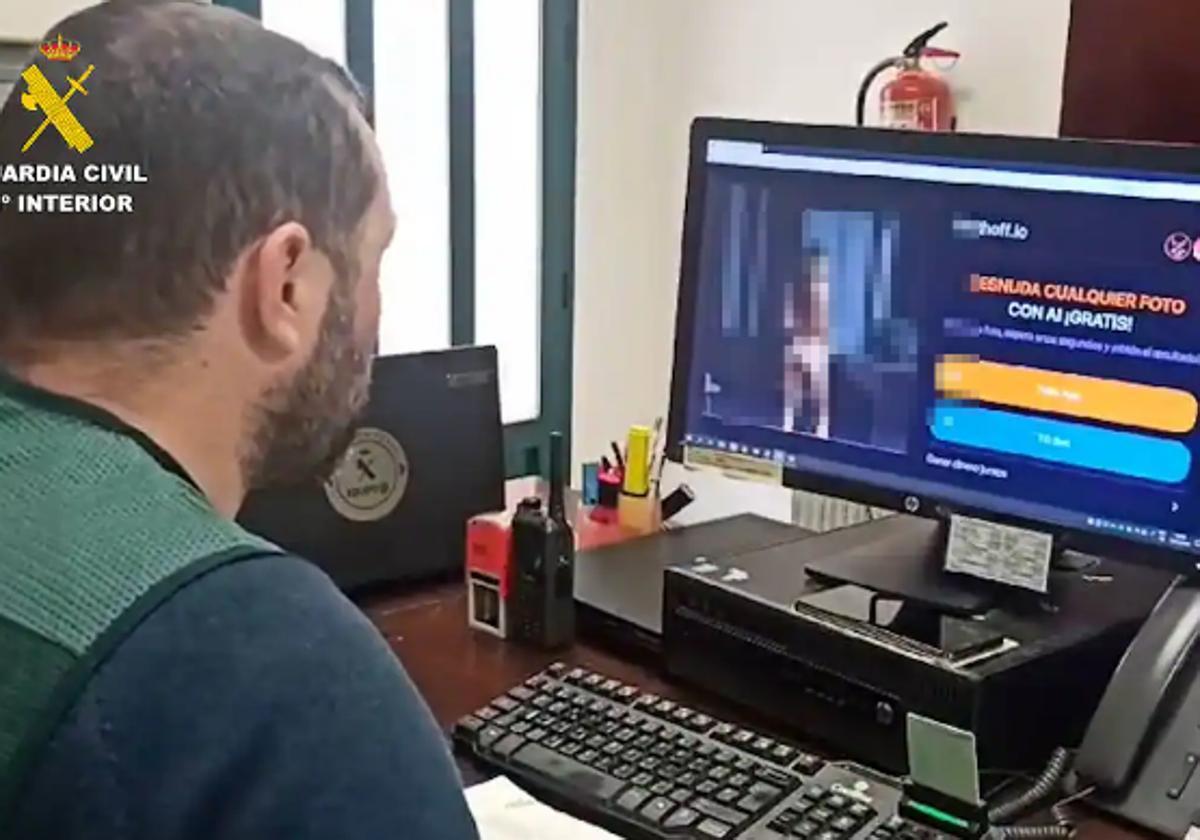

Un agente rastrea aplicaciones que manipulan imágenes para crear desnudos. / El Día

De todos modos, José Andrés Moreno puntualiza que «se puede pero no es sencillo conseguir una restricción o bloqueo completa». «Existen muchos trucos y tecnología para saltarse los bloqueos». Por eso, para el catedrático es vital la educación. «Un proceso educativo sólido, que fomente personas que sepan perfectamente dónde están los límites y que cosas se pueden y no se pueden hacer, es la mejor medida para evitar unas conductas que está claro que fomentan la violencia y la desigualdad, y crean modelos de comportamiento sexistas y machistas».

Juan Albino incide en otro aspecto. «Los menores no deberían usar el móvil sin ningún control. Las familias tienen que saber por dónde se mueven y que información están recibiendo, y tienen que responder si encuentran contenidos inadecuados, que pueden distorsionar el proceso educativo. No es tan complicado supervisar los dispositivos o restringir su uso».

Una buena idea para estos expertos es que se lanzaran campañas de concienciación para que toda la sociedad dispusiera de las herramientas necesarias para abordar estos nuevos desafíos, que se renuevan a una velocidad de vértigo. «Lo importante no es que se bloqueen estas webs y aplicaciones; lo importante es que la persona tenga claro por su propia formación que determinados usos y contenidos son inadecuados y no se pueden tolerar en la sociedad», concluye José Andrés Moreno.

- Primer municipio de Tenerife que toma medidas drásticas por la sequía: La Guancha restringe el uso del agua de grifo hasta para beber

- Poco más de mil euros por metro cuadrado: el municipio de Tenerife donde más barato sale comprar una vivienda

- Adiós a una de las paradas de guaguas más peligrosas de Tenerife: el Cabildo mejorará el lugar donde esperan decenas de personas cada día

- Un idea loca" y cien alumnos para cumplir un hito: un instituto de Tenerife busca entrar en el Libro Guinness de los récords

- Tenerife mejora la movilidad con 560 millones en cinco obras en las carreteras

- La Guancha, un caso único en Canarias en el abastecimiento de agua a la población: las razones por las que ha prohibido beber del grifo a sus 5.500 habitantes

- Tenerife cobrará una tasa a los visitantes por acceder a los espacios naturales protegidos

- Valery Álvarez, del Aula de la Cultura del Carnaval, reina de las Fiestas de Mayo